AI 将倒逼 CAD 平台变得更可解释

引言

工程团队长期以来习惯于容忍 CAD 系统中的“不透明性”。设计师面对行为不可预测的特征、缺乏解释的约束失败,往往将这些问题视为工具固有的一部分,甚至像讨论天气一样谈论模型重建错误。这种容忍曾是默认前提。

但随着 AI 进入建模环境,这种前提正在迅速瓦解。

AI 无法在黑箱中工作。它依赖清晰的结构、可解析的语义以及可追溯的逻辑关系。更重要的是,它必须能够解释自身的判断过程。一旦 AI 成为设计协作的一部分,CAD 平台将面临新的基础性要求——可解释性(Interpretability)。

当建模系统本身不可理解,AI 无法发挥作用

传统 CAD 系统普遍以隐式方式存储设计意图:

特征之所以有效,往往依赖其创建顺序;约束的行为,则取决于历史引用关系。这些依赖关系至关重要,却难以被直接观察。

工程师可以依赖经验进行推断,而 AI 则不具备这种“经验补偿能力”。它需要显式、结构化的信息。如果模型结构隐藏在复杂的依赖链之中,AI 将无法进行有效推理,也无法提供可靠建议。

因此,可解释性并非附加属性,而是 AI 发挥价值的前提条件。缺乏透明性,AI 无法解释建议、评估风险,更无法预测模型对变更的响应。

工程师需要理解 AI 的“为什么”

即使 AI 能给出正确答案,工程师也不会在缺乏解释的情况下信任它。

他们需要知道:

为什么某个约束被认为脆弱?

为什么某种特征顺序会增加长期风险?

如果 AI 无法解释其推理逻辑,设计决策将退化为猜测,而在工程场景中,猜测是不可接受的。

可解释性由此成为信任的基础。当 AI 能够揭示结构性问题并展示其背后的模式时,工程师可以基于逻辑本身进行判断。讨论的焦点也从“我是否相信结果”,转变为“这一推理是否符合我对模型的理解”。

可解释模型更易维护与演进

现实中,大量工程团队继承的是结构复杂且脆弱的模型。由于缺乏对内部逻辑的理解,设计师往往避免修改关键特征,导致模型逐渐僵化。

当模型具备可解释性,这一局面将发生改变。

如果工具能够清晰展示变更传播路径、关键约束结构以及依赖关系,设计师便可以更有信心地进行重构与优化。AI 在此过程中进一步放大这一趋势——它要求模型具备清晰逻辑,同时也推动这种清晰性成为人类工程师的共同收益。

可解释性是组织知识的载体

工程知识往往隐含在资深设计师的经验之中。一旦人员流动,这部分认知随之流失。

可解释 CAD 模型将设计意图和结构逻辑显式化,使知识直接嵌入模型本身,而非依赖个人记忆。这使得设计演化路径可追溯、可理解,从而形成组织层面的“结构化记忆”。

AI 在此基础上可以进一步提取模式、还原设计决策逻辑,使历史模型成为可复用的知识资产。

AI 将推动 CAD 形成更严格的内部语言体系

当 AI 需要读取并解释模型时,CAD 系统必须演进其内部表达方式:

这一转变并非限制工具能力,而是提升其可推理性。

一个能够“自解释”的模型,将具备更强的鲁棒性、更高的复用性,以及在需求变化下更好的适应能力。

Zixel 观点

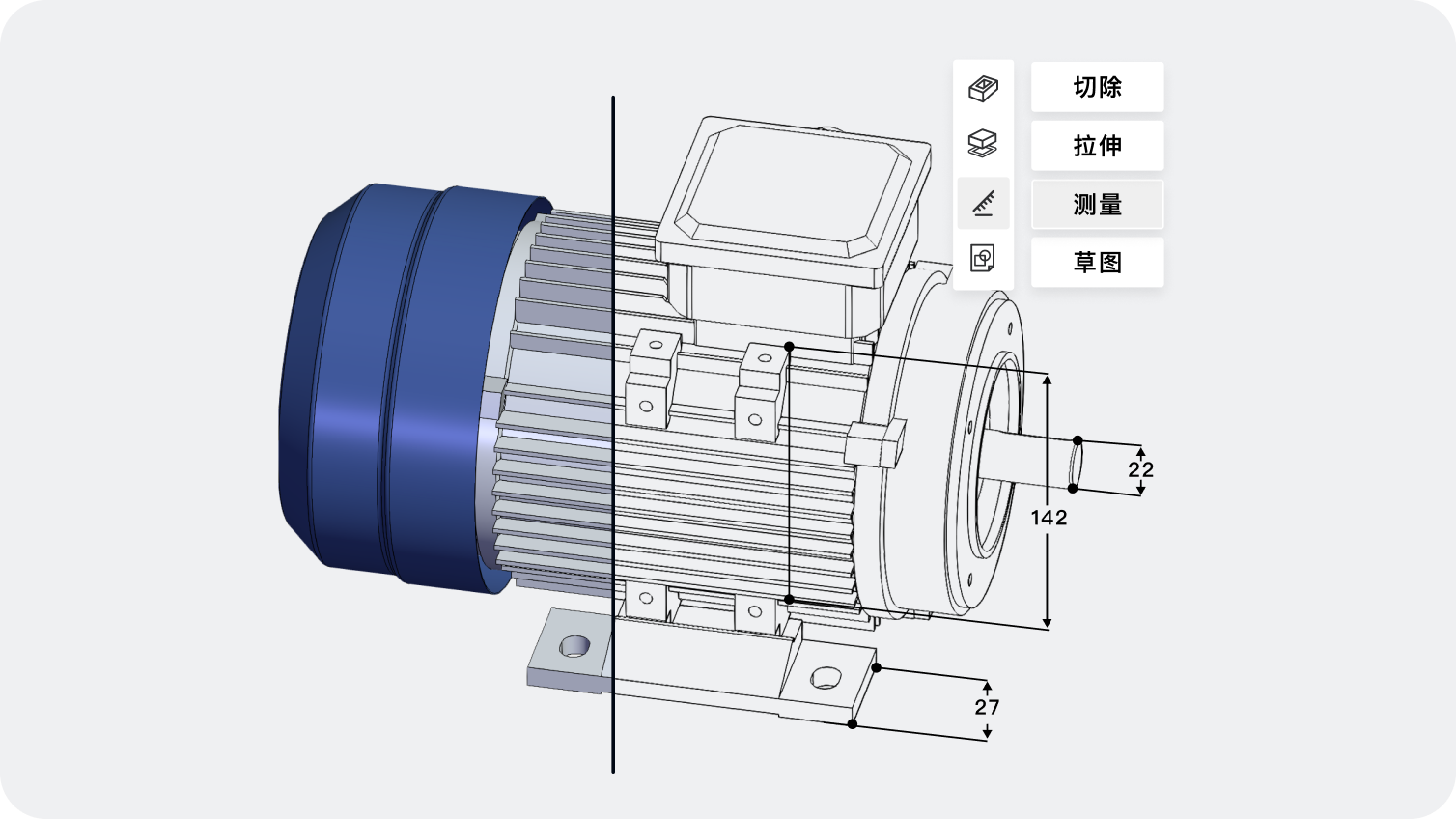

在 Zixel,我们认为可解释性将定义 CAD 的下一代范式。我们的云原生平台以“清晰性”为核心原则构建——清晰的历史、清晰的结构、清晰的特征关系。

AI 能力正是建立在这种透明性之上:帮助设计师理解意图、评估风险并做出高置信度决策。

我们不将可解释性视为约束,而将其视为更高质量工程的基础。当模型能够“表达自身”,人类与 AI 才能形成真正有效的协同。

结论

随着 AI 深度融入工程流程,可解释性将从“锦上添花”转变为“基础设施”。

未来的 CAD 系统,必须能够解释其行为本身——只有这样,工程团队才能在复杂设计中保持可控性、可理解性与决策信心。

版权声明:

- 凡本网站注明“来源子虔科技”或者“来源ZIXEL”的所有作品,均为本网站合法拥有版权的作品,未经本网站授权,任何媒体、网站、个人不得转载、链接、转帖或以其他方式使用。

- 经本网站合法授权的,应在授权范围内使用,且使用时必须注明“来源子虔科技”或者“来源ZIXEL”,并且不得对作品中出现的“子虔科技” “ZIXEL”字样进行删减、替换等。违反上述声明者,本网站将依法追究其法律责任。

- 本网站的部分资料转载自互联网,均尽力标明作者和出处。本网站转载的目的在于传递更多信息,并不意味着赞同其观点或证实其描述,本网站不对其真实性负责。

- 如您认为本网站刊载作品涉及版权等问题,请与本网站联系(邮箱:support@zixel.cn,电话:189 1853 8109),本网站核实确认后会尽快予以处理。

推荐阅读

PRT格式详解:不只是Pro/E的专属文件

提到 PRT 格式,大多数人的第一反应都是「Pro/E

的文件」。PTC Creo(也就是大家熟悉的

Pro/E)确实是让 PRT

格式广为人知的那个软件。但如果因此就认为 PRT 是

Pro/E 的私有格式,那理解上就差了一截。 PRT,全称

Part,说到底是一种存储三维零件或组件数据的通用容器格式。西门子

NX(也叫 UG)可以生成和编辑 PRT 文件,达索的

SolidWorks 同样支持 PRT 格式的读写。 一个 PRT

文件,存的不只是一个三维形状。打开一个

PRT,里面有零件完整的几何形状和拓扑结构。但更关键的是参数化特征——设计师通过拉伸、倒角、打孔等特征操作来定义零件,这些

2026-04-17 12:00

DWG文件打不开?问题根源往往不在软件本身

拿到一个DWG文件,打不开——大多数人的第一反应是去搜「用什么软件打开DWG」。但很多时候软件其实不是症结所在。

文件打开失败,有超过一半的情况跟软件根本没关系。真正的原因往往藏在文件本身:文件正被另一个程序占用、网络传输中已损坏、存放位置权限不对等。

文件被占用:弹窗「当前正在使用或为只读文件」。打开系统「资源监视器」,结束占用进程。

文件损坏:可以先试试 AutoCAD 自带的 RECOVER

命令修复,或找 .bak 备份文件改扩展名重试。

版本不兼容:软件直接拒绝打开或提示「该文件由更高版本创建」。让对方「另存为」降版本,或找更高版本软件打开。

需要编辑改图出图:AutoCAD(行业标

2026-04-17 12:00

未来 CAD 系统将从"形状驱动"走向"行为驱动"

大多数 CAD

系统仍然主要关注形状。但随着产品变得越来越复杂,团队希望工具能揭示更多几何形状之外的信息,未来的

CAD 将不再关注零件的外观,而是关注它的功能。

模型在屏幕上看起来可能完美无缺。但一旦进入现实世界,问题就会出现——零件会以模型未体现的方式弯曲,装配体在负载下会移动。传统

CAD 把产品看作是固定不变的雕塑。未来的 CAD

会将它们视为随时间变化的动态系统。

为什么那个肋条更厚?为什么这个铰链的行程有限?行为能揭示这些设计决策背后的原因——显示改变一个元素会如何影响整个系统。

当 CAD

展示行为时,每个人都能看到相同的关系。制造团队能理解零件如何移动和变形。装配团队能看到公差

2026-04-17 12:00

AI 驱动的"学徒制"将让设计师成长更快

每个设计师都记得他们的早期时光——那些修复破损模型的漫长夜晚,对特征顺序的迷茫,以及对什么能让设计可制造的不确定。过去,这个学习过程很漫长,因为它依赖于实践经验。

人工智能能提供一些专家级的线索。当预测性 CAD

指出弱依赖关系或可能引发问题的公差时,它就在复制那种曾经需要多年经验才能获得的洞察力。学徒制不再是等着问题出现,而是要学会尽早发现问题。

人工智能驱动的建模环境极大地缩短了这个过程——当设计师调整表面时,工具能立即显示约束网络的反应,这样学习效果会更好。

真正的学徒制不只是纠正错误。它是要提出更好的问题,理解利弊权衡,明白约束条件存在的原因。人工智能加快了实践经验的积累,但人类导师仍

2026-04-17 12:00

AI CAD 时代,什么才叫"系统性思考"

工程师常常被提醒要"系统思考",但这个说法通常只出现在教科书里,在日常的建模工作中很少被用到。大多数计算机辅助设计(CAD)的工作流程还是围绕着零件、特征和装配来进行。

大多数 CAD

软件还是把几何图形作为主要的输出结果。但现实世界更关注产品的行为。几何图形应该是实现逻辑的手段,而不是目的本身。

传统的 CAD

软件常常会隐藏上下文信息,因为所有内容都包含在静态的特征和草图里。人工智能可以找到缺失的上下文信息——它能识别出哪些特征控制着对齐方式、哪些约束包含着结构逻辑。

当设计建立在明确的意图、稳定的约束和可预测的关系之上时,它就能顺利地进行调整。人工智能可以发现设计中比较薄弱的区域,突出显

2026-04-17 12:00

ZIXEL 云原生 3D CAD 产品设计协作平台

)

- 在线编辑 多人协作

- 复杂设计 流畅运行

- 50+ 主流格式兼容

- AI创成式 智能建模

推荐

最新

ZIXEL专属顾问服务

扫码添加顾问微信

获取企业专属技术支持

1V1快速响应

1V1快速响应