为什么下一代CAD在设计上就将可解释

概述

当人工智能开始参与设计决策时,一个根本性的问题浮现出来:为什么AI做了这个建议?设计师需要理解AI如何做出决策,团队需要看到设计推理而非仅看到几何。不可解释的系统迟早会被放弃——能够展示推理过程的CAD才能建立真正的信任,让AI与设计师成为真正的协作者。

AI黑盒问题在设计中的特殊性

人工智能在设计领域面临一个独特的挑战:设计是高度主观的。 在图像识别或语音识别等任务中,存在客观的"正确答案"。但在产品设计中,什么是"好"的设计往往取决于多种因素——功能、成本、美观、可制造性、可靠性、安全性。这些因素之间的权衡往往是主观的、上下文相关的。 当AI在这样的领域中给出建议时,设计师面临的挑战不仅是"AI说什么",更是"AI为什么这样说"。如果设计师无法理解AI的推理过程,他们就无法评估建议的质量,也就不敢采纳建议。

信任的建筑

人机协作的基础是信任,而信任的基础是理解。 当一个人说"我认为你应该这样做",另一个人会评估这个建议——基于说话者的专业知识、经验、对情况的了解程度。如果你不了解说话者,你就无法判断建议的价值。 AI建议也是一样。设计师需要理解AI从哪里获得信息、基于什么逻辑做出判断、考虑了哪些因素。没有这种理解,设计师只能盲目信任或盲目拒绝——两者都不是好的选择。 盲目的信任可能导致采纳错误的建议。盲目的拒绝意味着完全浪费了AI的能力。唯一健康的路径是"知情信任"——理解AI的推理,然后做出知情的决策。

可解释性的多层含义

可解释性在CAD中有多个层次的含义: 输入解释:AI看到了什么信息?它考虑了哪些设计参数、历史数据、仿真结果?这种解释帮助设计师了解AI的视野。 推理解释:AI基于什么逻辑得出这个建议?它考虑了哪些因素?权重是多少?这种解释帮助设计师理解AI的思维方式。 输出解释:这个建议为什么是这个值?边界在哪里?敏感性如何?这种解释帮助设计师评估建议的适用性。 反事实解释:如果改变某个参数,结果会如何变化?这种解释帮助设计师理解设计空间的结构。

从几何到推理

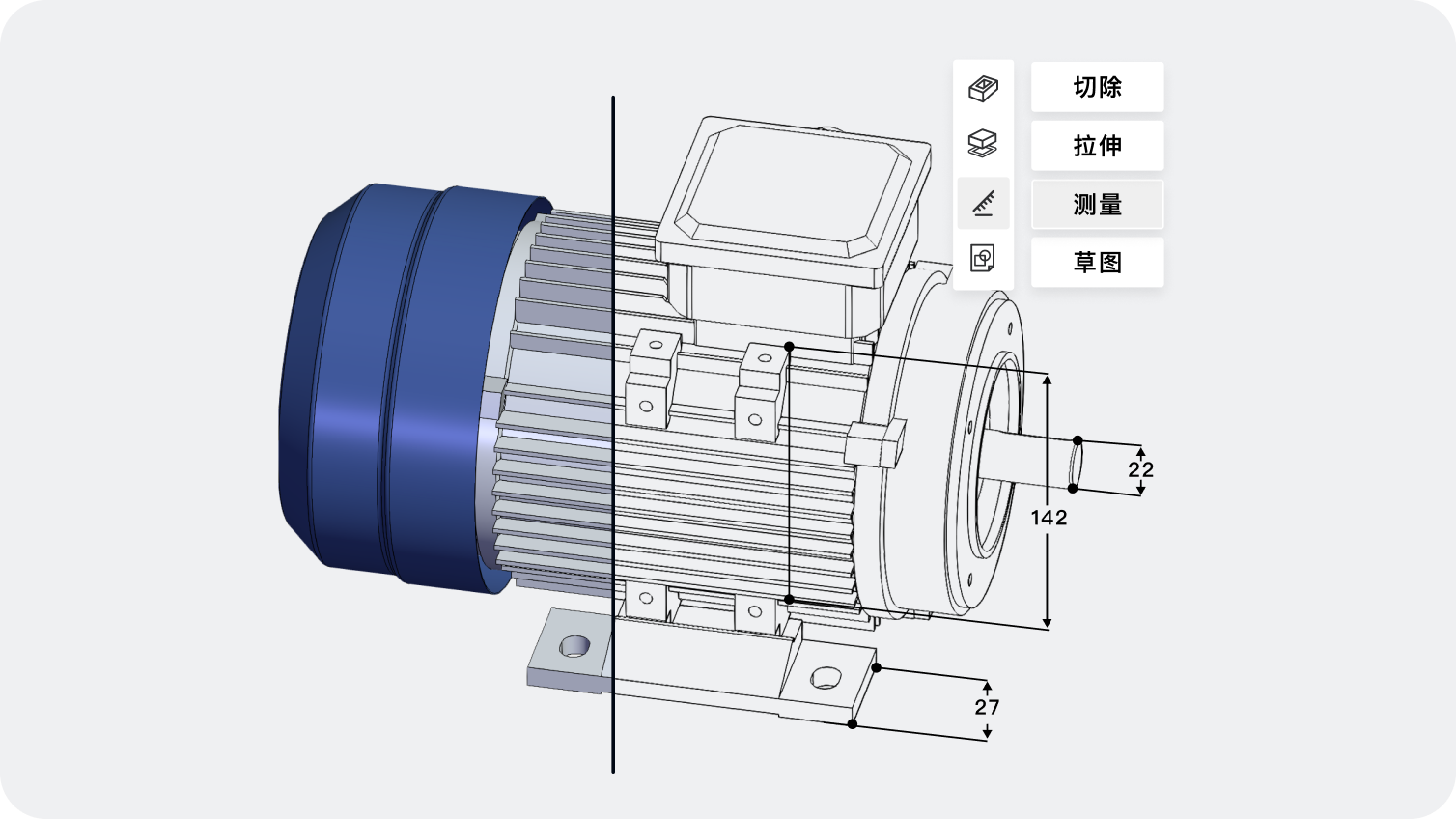

下一代CAD需要从"显示几何"扩展到"展示推理"。 当设计师与AI协作者交互时,他们不仅需要看到AI生成的几何结果,还需要看到AI的思考过程: 这种推理的可视化使得设计师能够与AI进行真正的对话——不是单向地接受建议,而是能够质疑、探索、改进。

交互式探索

可解释的AI使得交互式探索成为可能。 设计师可以问:"如果你放宽这个约束,会怎么样?""如果材料换成铝合金,性能如何变化?""如果制造成本限制在某个水平,最优设计是什么?" AI不仅给出答案,还解释为什么。当设计师看到AI的回答和解释后,他们可以进一步追问、验证假设、探索边界。这种对话式的交互比简单的"输入-输出"模式强大得多。

建立真正的协作者关系

可解释性使得AI从"工具"升级为"协作者"。 工具是被动的——你告诉它做什么,它就做什么。你不需要理解工具的"思维",只需要正确地使用它。但协作者是主动的——它有观点、有建议、有专业判断。它需要你理解它的想法,以便你们能够真正合作。 当CAD中的AI能够解释它的推理时,它就成为了真正的协作者。设计师可以与它讨论、争论、探索。"我不同意你的这个假设,你怎么看?""你有没有考虑过这个因素?""基于你的分析,你最推荐哪个方案?" 这种协作者关系比工具使用关系强大得多。AI的专业知识可以被充分利用,而设计师的专业判断仍然处于主导地位。

商业价值

可解释性不仅有技术价值,也有商业价值。 当AI建议可以被解释时,企业可以更好地评估AI系统的ROI——AI的建议带来了多少价值?哪些类型的建议最有用?AI在哪些领域表现最好?这些洞察帮助企业优化AI的应用策略。 当AI建议可以被审计时,企业可以更好地管理风险——在关键设计决策中,AI的推理是否合理?是否有被忽视的因素?这种审计能力对于高风险行业(如航空、医疗)尤为重要。

技术路径

实现可解释性有多条技术路径: 规则可解释:使用基于规则的AI系统,而不是深度学习黑盒。规则是透明的,可以被理解和审计。 模型可解释:使用可以被解释的机器学习模型,如决策树、线性模型,而不是不可解释的深度神经网络。 后验解释:即使使用黑盒模型,也可以使用解释技术(如LIME、SHAP)来近似解释模型的决策。 因果推理:超越相关性,建立因果模型,使得推理更加可靠和可解释。

展望

下一代CAD将在设计上就可解释。这不仅仅是一个功能特性,而是设计AI范式的基础。 当设计师能够理解AI的推理时,他们才能真正与AI协作。当AI能够解释它的建议时,团队才能真正信任AI。这种信任和理解是释放AI在设计领域全部潜力的关键。 那些率先实现可解释AI的CAD系统,将在竞争中占据优势。因为它们提供的不仅仅是AI的能力,而是与AI协作的能力——这是设计师真正需要的东西。

版权声明:

- 凡本网站注明“来源子虔科技”或者“来源ZIXEL”的所有作品,均为本网站合法拥有版权的作品,未经本网站授权,任何媒体、网站、个人不得转载、链接、转帖或以其他方式使用。

- 经本网站合法授权的,应在授权范围内使用,且使用时必须注明“来源子虔科技”或者“来源ZIXEL”,并且不得对作品中出现的“子虔科技” “ZIXEL”字样进行删减、替换等。违反上述声明者,本网站将依法追究其法律责任。

- 本网站的部分资料转载自互联网,均尽力标明作者和出处。本网站转载的目的在于传递更多信息,并不意味着赞同其观点或证实其描述,本网站不对其真实性负责。

- 如您认为本网站刊载作品涉及版权等问题,请与本网站联系(邮箱:support@zixel.cn,电话:189 1853 8109),本网站核实确认后会尽快予以处理。

推荐阅读

当制造反馈循环重写早期建模过程时

传统上,设计从理想几何开始,然后接受制造评审。当反馈在建模时实时到达时,设计师从一开始就将可制造性编码进结构。这种变化将返工从设计周期的结尾转移到设计的最早阶段,从根本上重新定义了设计的起点。

## 传统设计流程的线性假设

传统产品开发流程建立在一个线性假设之上:设计...

2026-04-14 01:00

当现场性能影响下一代建模工具时

## 概述

当现场性能数据开始流入设计系统时,工程设计进入了一个反馈闭环。传感器数据、维护记录、保修信息都开始塑造设计决策的方向。CAD不再只反映工程师的想法,还反映产品在实际使用中的表现。这从根本上改变了"好设计"的定义标准。

## 从虚拟到真实 传统CAD系统是虚拟的——它们...

2026-04-14 01:00

为什么明天团队的沟通将完全不依赖文件

## 概述

文件是工业时代的产物——它们捕获快照,携带几何,但不携带意图、推理或决策背景。当团队在共享环境中工作时,沟通围绕模型展开而非关于模型——对话更加精准,因为上下文始终存在于共享空间。文件作为协作媒介的角色正在走向终结。

## 文件的根本局限

文件有几个根本性的局限,这些...

2026-04-14 01:00

为什么下一代CAD在设计上就将可解释

## 概述

当人工智能开始参与设计决策时,一个根本性的问题浮现出来:为什么AI做了这个建议?设计师需要理解AI如何做出决策,团队需要看到设计推理而非仅看到几何。不可解释的系统迟早会被放弃——能够展示推理过程的CAD才能建立真正的信任,让AI与设计师成为真正的协作者。

## AI黑...

2026-04-14 01:00

为什么流程感知CAD将取代纯几何思维

## 概述

传统CAD擅长描述形状,但不擅长捕获形状如何被生产、检验或维护。这种局限性导致了设计和制造之间的鸿沟。当CAD反映真实的制造和流程约束时,工程师不再只问"模型看起来对吗",而是问"这个设计在实际流程中是否可行"。流程感知CAD代表了超越纯几何思维的一次飞跃。

## 纯...

2026-04-14 01:00

ZIXEL 云原生 3D CAD 产品设计协作平台

)

- 在线编辑 多人协作

- 复杂设计 流畅运行

- 50+ 主流格式兼容

- AI创成式 智能建模

推荐

最新

ZIXEL专属顾问服务

扫码添加顾问微信

获取企业专属技术支持

1V1快速响应

1V1快速响应